Der EU AI act – Bedeutung für Bildungseinrichtungen

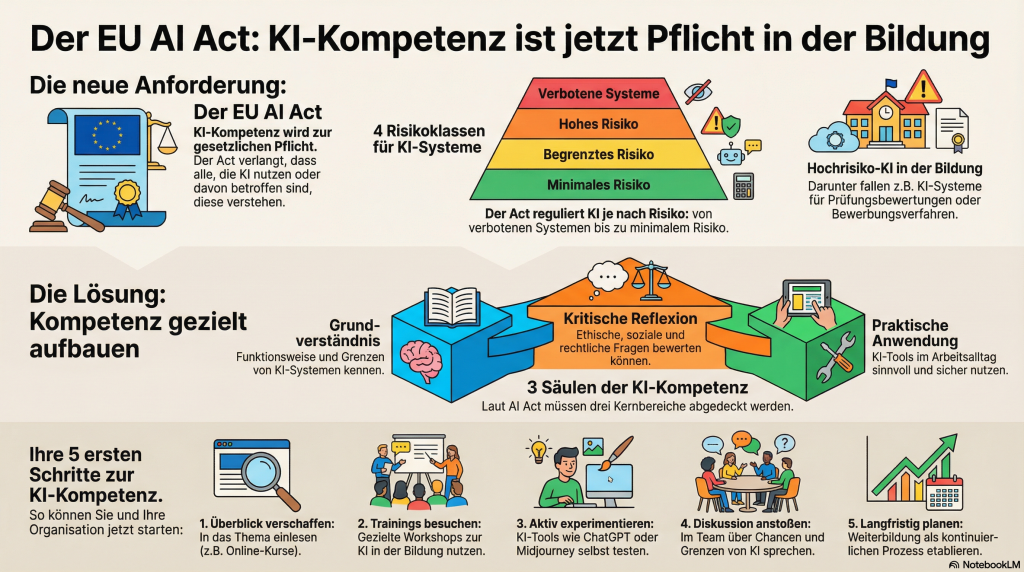

Mit dem EU AI Act schafft die Europäische Union erstmals einen verbindlichen Rechtsrahmen für den Einsatz Künstlicher Intelligenz. Auch wenn der Bildungsbereich häufig als „geschützter Raum“ wahrgenommen wird, ist er explizit von der Verordnung betroffen. KI wird zunehmend für Lernunterstützung, Leistungsbewertung, Prüfungsüberwachung und Verwaltung eingesetzt – genau hier setzt der EU AI Act an.

Dieser Beitrag gibt einen rechtssicheren Überblick, ordnet die Auswirkungen für Bildungseinrichtungen ein und zeigt, was jetzt konkret vorzubereiten ist. Zudem wird deutlich, wie die KI-Kompetenz in Bildungseinrichtungen als Pflicht und Auftrag wahrgenommen werden kann.

1. Was ist der EU AI Act?

Der EU AI Act ist eine EU-Verordnung (keine Richtlinie).

Er gilt unmittelbar in allen Mitgliedstaaten – auch in Deutschland. Eine nationale „Umsetzung“ ist nicht erforderlich; nationale Gesetze regeln lediglich Zuständigkeiten und Aufsicht.

Ziel der Verordnung ist:

- Schutz von Grundrechten und Sicherheit

- Transparenz und Nachvollziehbarkeit von KI

- Förderung vertrauenswürdiger KI

- Ermöglichung von Innovation unter klaren Regeln

2. Zeitplan: Ab wann gilt was?

Für Bildungseinrichtungen sind folgende Stichtage relevant:

- ab 02.02.2025

→ Verbot bestimmter KI-Praktiken (z. B. Social Scoring) - ab 02.08.2025

→ Pflichten für Anbieter und Betreiber von General-Purpose-AI (z. B. große Sprachmodelle) - ab 02.08.2026

→ Anwendung der meisten Pflichten, insbesondere für Hochrisiko-KI im Bildungsbereich

➡️ 2026 ist der zentrale Zeitpunkt, an dem Schulen und Hochschulen prüfungs- und organisationssicher aufgestellt sein müssen.

3. Warum Bildung ein Hochrisiko-Bereich ist

Der EU AI Act stuft bestimmte KI-Anwendungen in Bildung und beruflicher Bildung ausdrücklich als Hochrisiko-KI ein (Anhang III). Dazu gehören KI-Systeme zur:

- Entscheidung über Zugang, Zulassung oder Zuweisung

- Bewertung von Leistungen und Prüfungen

- Einstufung von Lernenden

- KI-gestützten Prüfungsüberwachung (Proctoring, Cheating Detection)

Diese Systeme sind nicht verboten, dürfen aber nur unter strengen gesetzlichen Bedingungen eingesetzt werden.

4. Pflichten für Bildungseinrichtungen bei Hochrisiko-KI

Setzt eine Bildungseinrichtung Hochrisiko-KI ein, muss sie sicherstellen:

- Menschliche Aufsicht

→ KI darf nicht autonom über Bildungswege oder Leistungen entscheiden - Transparenz und Nachvollziehbarkeit

→ Funktionsweise und Einsatz müssen erklärbar sein - Dokumentation und Zweckbindung

→ Warum wird das System eingesetzt? Mit welchen Daten? - Bias- und Diskriminierungsschutz

→ Besonders relevant bei Bewertungen und Prognosen - Datenschutzkonformität

→ Ergänzend zur DSGVO (keine Profilbildung, Schutz Minderjähriger)

➡️ Die Verantwortung bleibt immer bei der Einrichtung, nicht beim Anbieter.

5. Generative KI im Unterricht: Was ist erlaubt?

Generative KI (z. B. Chatbots, Text- oder Bildgeneratoren) fällt meist nicht automatisch unter Hochrisiko-KI. Es gelten jedoch Transparenzpflichten:

- Lernende müssen erkennen können, dass sie mit KI arbeiten

- KI-generierte Inhalte müssen kontextabhängig kenntlich sein

- Lehrkräfte müssen auf Grenzen, Fehler und Verzerrungen hinweisen

Eine pauschale Kennzeichnungspflicht für alle Inhalte besteht nicht – wohl aber eine didaktische und rechtliche Transparenzpflicht.

6. Prüfungen und Leistungsbewertung – rechtlich sauber eingeordnet

Der EU AI Act verbietet nicht den KI-Einsatz in Prüfungen. Er macht aber deutlich:

- Leistungsbewertung darf nicht vollständig automatisiert erfolgen

- KI darf unterstützen, nicht entscheiden

- Besonders sensible Verfahren (z. B. Proctoring) gelten als Hochrisiko-KI

- Zusätzlich gilt weiterhin Art. 22 DSGVO (Schutz vor automatisierten Entscheidungen mit erheblicher Wirkung)

➡️ Didaktische Konsequenzen wie Präsentationen, mündliche Prüfungen oder Reflexion der KI-Nutzung sind keine gesetzlichen Pflichten, aber eine pädagogisch logische Reaktion auf den Rechtsrahmen.

7. Organisatorische Folgen für Bildungseinrichtungen

Der EU AI Act macht KI zu einem Thema der Schul- und Organisationsentwicklung:

- Entwicklung verbindlicher KI-Leitlinien

- Prüfung eingesetzter Tools auf AI-Act-Relevanz

- Qualifizierung von Lehrkräften (Recht, Ethik, Didaktik)

- Klare Zuständigkeiten (Leitung, IT, Datenschutz)